En 2016 Intel anunció su intención de despedir a lo largo del año a 12.000 de sus trabajadores, lo que suponía prescindir del 11% de su plantilla en ese momento. La razón principal es la gran caída que está experimentando la venta de microprocesadores para PC de sobremesa y ordenadores portátiles, donde Intel es el líder del mercado, frente al aumento de las ventas de microprocesadores para móviles, donde le ha ganado la batalla AMD, que equipa la mayoría de smartphones y tablets, tanto de Apple, como para sistema operativo Android. Con este plan de reestructuración Intel quiere centrar su actividad en las nuevas áreas de crecimiento que han mostrado tener mayor potencial, que son los chips para Internet of Things (IoT) y los chips de memoria, que ya suponen casi el 40% de los ingresos del fabricante y un porcentaje aún mayor de los beneficios. Gracias a esta nueva estrategia Brian Krzanich, presidente de la empresa busca posicionar a Intel como líder en un mundo conectado.

El anuncio del plan de reestructuración de la compañía también coincidió con la noticia de la reducción del ritmo de disminución del tamaño de los chips, que ha sido capaz de mantener Intel desde la década de 1970. En el informe que presentó la compañía en el mes de febrero de 2016, indicaba que está reduciendo el ritmo al que lanza nuevas tecnologías de fabricación de chips, por lo tanto, el tiempo entre sucesivos lanzamientos de nuevas generaciones de chips con transistores más pequeños se ampliará. Actualmente Intel es capaz de producir transistores de un tamaño de 14 nanómetros, pero se está complicando reducirlos más de forma que resulte rentable producirlos. De esta forma ha tenido que retrasar la presentación en el mercado de sus chips de 10 nanómetros, lo cual es una muestra patente de la ralentización de la ley de Moore.

La ley de Moore fue formulada en 1965 por Gordon E. Moore, cofundador de Intel, y establecía que el número de transistores por unidad de superficie en circuitos integrados se duplicaría cada 2 años y que la tendencia continuaría durante las siguientes 20 años. La realidad ha sido que la Ley de Moore ha mantenido su crecimiento durante 50 años, pero esto está llegando a su fin. Por esto, ahora más que nunca, es necesario encontrar alternativas a las formas actuales de fabricación de microchips basados en silicio. La primera línea de trabajo, en lo que a alternativas al silicio se refiere, la encontramos en otros materiales semiconductores que podrían ofrecer mejores opciones que el silicio, para seguir disminuyendo el tamaño de los transistores que conforman los microchips. El arseniuro de indio y galio es el nuevo material para la fabricación de transistores, en el que lleva un tiempo trabajando un equipo del MIT liderado por el español Jesús del Álamo que ha logrado fabricar el transistor más pequeño jamás construido con este material, con el objetivo de conseguir que los electrones puedan viajar tres veces más rápidos que con el silicio.

En el campo específico de la computación, de la lógica, cada vez está resultando más difícil hacer procesadores más pequeños y a la vez más potentes. Y en este área al silicio ya se le ve un fin. Gracias al arseniuro de Galio e Indio, podemos llegar más allá de donde nos pueda llevar el silicio. Los electrones se mueven más rápidamente y necesitan menos energía. Jesús del Álamo, director del laboratorio de microsistemas del MIT

Otros materiales en con los que se está trabajando como alternativa al Silicio para poder crear transistores son la Magnetita y la Molibdenita. En el caso de la Magnetita están trabajando los investigadores del U.S. Department of Energy’s (DOE) SLAC National Accelerator Laboratory, quienes han demostrado que se pueden fabricar transistores capaces de conmutar miles de veces más rápido que los fabricados con silicio. Lo han logrado utilizando impulsos láser con los que han sido capaces de conmutar las propiedades de la magnetita entre aislante y conductor. Este fenómeno se debe a la presencia de unas áreas llamadas «timerons» formadas por átomos de hierro. La velocidad lograda ha sido de 1 THz y demuestra su elevada capacidad de conmutación, pero aún se encuentra lejos de poder convertirse en una alternativa real al silicio ya que la temperatura que se requiere para su funcionamiento está muy por debajo de la temperatura ambiente. En el caso de la Molibdenita, que es utilizada como aditivo para lubricantes sometidos a extrema presión, el Laboratorio de Electrónica y Estructuras a Nanoescala (LANES) ha demostrado sus aplicaciones dentro del mundo de la electrónica, por su similitud con el silicio en cuanto a comportamiento, permitiendo una mayor capacidad de integración y un menor consumo. Gracias a este material bidimensional se podrían construir transistores que consuman 100.000 veces menos energía en estado suspendido que los tradicionales transistores de silicio. Con este material también está trabajando la Ecole Polytechnique Fédérale de Lausanne (EPFL) que ha sido capaz de desarrollar un circuito integrado y asegura que se podría llegar a reducir hasta tres veces el tamaño de los fabricados con silicio, además de ofrecer un menor consumo energético.

Los Nanotubos de Carbono también están siendo investigados por las posibilidades que pueden llegar a ofrecer como alternativa al silicio para la fabricación de microprocesadores. En concreto tanto la empresa IBM, como investigadores de la Universidad de Stanford, han logrado construir una computadora con un procesador de nanotubos de carbono en lugar de silicio, demostrando que se trata de un material que funciona mejor como semiconductor para los transistores y permite lograr un tamaño mucho más pequeño que los de silicio, con dimensiones inferiores a 10 nanómetros. De esta forma, un procesador construído con nanotubos de carbono puede llegar a ser hasta 3 veces más rápido que un procesador de silicio. Además, el carbono también tiende a generar menos calor y, al fabricarse transistores mucho más pequeños, es posible disponer de un mayor número de ellos en el mismo espacio. El objetivo de IBM es contar con el primer microchip comercial fabricado con nanotubos de carbono en el año 2020.

El principio de la era del Grafeno

El Grafeno también se presenta como un gran aliado para el futuro de la industria tecnológica y al igual que hemos visto en el caso de los nanotubos de carbono, también está siendo IBM uno de los pioneros en el estudio de este material, como alternativa al silicio, para la fabricación de microprocesadores. En concreto la empresa ha logrado crear un chip de silicio recubierto de grafeno, que es capaz de multiplicar por 10.000 la potencia de los chips actuales, fabricados únicamente con silicio, y también multiplicar la velocidad casi por 4, llegando a los 100 GHz. Cuando esta tecnología pueda llegar a aplicarse a nivel comercial se contará con microprocesadores de 25 a 50 veces más rápidos que los de silicio. La utilidad inicial de este chip estará en los teléfonos móviles donde puede ser utilizado como un receptor de radio que permite traducir las señales en información comprensible apta para ser enviada y recibida. IBM ya ha realizado pruebas con el envío de mensajes SMS y los resultados han sido satisfactorios. La parte negativa, como es habitual cuando hablamos del uso del grafeno como material, es el alto coste de su producción, que por el momento hace inviable su utilización de forma comercial en el corto plazo.

La utilización del grafeno para la fabricación de transistores denominados túnel-FET es otra de las novedosas líneas de trabajo que están surgiendo para superar las barreras actuales a las que se enfrenta la industria de los microprocesadores. En esta línea trabajan los físicos rusos Andréi Geim y Konstantín Novosiólov, junto con investigadores de la Universidad de Manchester, con quienes han logrado crear un transistor de túnel basado en grafeno que es apto para la producción industrial. El transistor de efecto túnel, a diferencia de los habituales transistores de efecto campo, utiliza el campo eléctrico para controlar la conductividad de un canal en un material semiconductor. Así sus canales se controlan con un efecto de túnel cuántico. Según la teoría cuántica, los electrones pueden cruzar la barrera aunque no tengan bastante energía para hacerlo. Reduciendo el ancho de la barrera, resulta posible amplificar el efecto cuántico y la energía que los electrones necesitan para cruzar la barrera se reduce drásticamente. En consecuencia, con el efecto de túnel se puede reducir el voltaje de los transistores, lo que ayudaría a reducir su consumo de energía.

Microprocesadores inspirados en la estructura del cerebro

Otra de las iniciativas de IBM en busca de superar las limitaciones de los chips actuales basados en silicio, consiste en modificar la estructura con la que habitualmente son diseñados, por ejemplo, con la alternativa de imitar la estructura que tiene el cerebro. De esta forma han desarrollado el chip TrueNorth, conformado por 5.000 millones de transistores que se organizan en 4.096 núcleos sinápticos. Este chip consigue imitar la acción de un millón de neuronas y 256 sinapsis con un consumo mínimo, sólo 0,063 vatios. Con este proyecto en IBM buscan reorientar el mundo de la computación hacia nuevos campos y posibilidades. TrueNorth no solo tiene ventajas en lo relativo a las capacidades de cómputo, sino también en lo que se refiere al reducido consumo energético, ya que su actual chip consume sólo 0,063 vatios, una fracción de lo que consumen las CPU de los ordenadores domésticos. El científico que lidera este proyecto es Dharmendra S. Modha, quien asegura que IBM ha sentado las bases de la computación inspirada en el cerebro humano, en los términos de una arquitectura de computación radicalmente nueva, a una escala sin precedentes, una velocidad, eficiencia, energía y capacidad de adaptación incomparables, y unas técnicas de diseño innovadoras. De esta forma se anticipan nuevas generaciones de sistemas de tecnologías de la información que complementen las actuales máquinas von Neumann, dotados de un ecosistema evolutivo de sistemas, software y servicios.

La empresa HP tampoco quiere quedarse fuera en la carrera por construir la próxima generación de microprocesadores y para ello ha puesto en marcha un proyecto llamado «La Máquina» en el que se combinan los memristors y la fotónica del silicio, para acabar con las limitaciones en capacidad y en velocidades de transferencia de los chips actuales. El memristor es una idea desarrollada por el ingeniero eléctrico Leon Chua y tiene la propiedad de parecerse mucho en su funcionamiento a las neuronas, que codifican, transmiten y almacenan la información. Los memristores mejoran la eficiencia energética y la de cómputo, solventando el denominado cuello de botella de Von Neumann, por el cual las memorias electrónicas actuales no pueden procesar datos y los procesadores no pueden retenerlos, por eso en los ordenadores es necesario disponer de esos dos elementos por separado. De esta forma la información debe ir y venir para procesar y guardar, pero no al mismo tiempo. El memristor puede hacer ambas cosas a la vez, por lo que se podría construir una memcomputadora, capaz de hacer mucho más rápido un cálculo, resolverlo y guardar la solución, ahorrando además toda la energía que antes se gastaba en mandar la información de un lado para otro. Para que este nuevo modelo de computación llegue a ser una realidad será necesario desarrollar un nuevo sistema operativo, en el que ya está trabajando la empresa, lo cual le servirá también como ayuda en su objetivo de recuperar el protagonismo en el mundo de la informática.

La Litografía Ultravioleta Extrema es otra de las técnicas en las que se está trabajando por parte de las grandes empresas de electrónica, para salvar el problema que supone la ralentización de la Ley de Moore por las limitaciones del silicio como semiconductor. Para fomentar el desarrollo de esta tecnología Intel ha invertido 4.000 millones de dólares en la empresa holandesa ASML, que fabrica los equipos que se emplean para fabricar chips. La inversión realizada está dando sus frutos ya que la empresa ha anunciado que ha superado el mayor reto técnico al que se había enfrentado hasta el momento, por lo que se puede seguir avanzando para que esta tecnología permita a Intel desarrollar una nueva generación de chips basados en láminas de 450 milímetros, que resulten más económicos y eficientes que los actuales de 300 milímetros.

Igualmente la Espintrónica se plantea como una tecnología que puede ayudar a superar las limitaciones actuales de la fabricación de microprocesadores. Se trata de una tecnología basada en el estado cuántico de los electrones y está siendo utilizada en discos duros avanzados para el almacenamiento de datos y acceso a memoria magnética aleatoria. Uno de sus primeros promotores fue el investigador Albert Fert quien en 1988 describió por primera vez la “magnetorresistencia gigante en multicapas metálicas“, que ocurría debido al desequilibrio entre el número de electrones espín arriba y el de espín abajo. Posteriormente en 1997 IBM decidió introducir la espintrónica en cabezas lectoras de discos duros de ordenador, permitiendo un incremento notable en la densidad de información almacenada magnéticamente que podía ser leída de modo eficiente.

Hasta que llegue la computación cuántica

Más allá de la utilización de nuevos materiales que acabamos de revisar, la computación cuántica se presenta como la alternativa más prometedora que existe en estos momentos para que el desarrollo de las tecnologías de computación pueda continuar en la senda del crecimiento por la que ha discurrido en los últimos 50 años. Se trata de una tecnología que se basa en una teoría ideada en 1981 por los físicos Paul Benioff y Richard Feynman, quienes propusieron aprovechar las leyes cuánticas en el mundo de la computación, de forma que en lugar de trabajar a nivel de voltaje eléctrico, se trabaja a nivel de cuanto; en lugar de basarse en los bits de la informática convencional se usarán los qubits, lo cual dará lugar a nuevos algoritmos de computación. Un ordenador cuántico funciona de manera completamente distinta a los ordenadores actuales: en lugar de estar basado en las puertas lógicas o combinación de puertas lógicas para procesar la información, va a trabajar con las reglas de la física cuántica. Los ordenadores cuánticos puedan aprovechar esas leyes para resolver los problemas de una manera más rápida y eficiente.

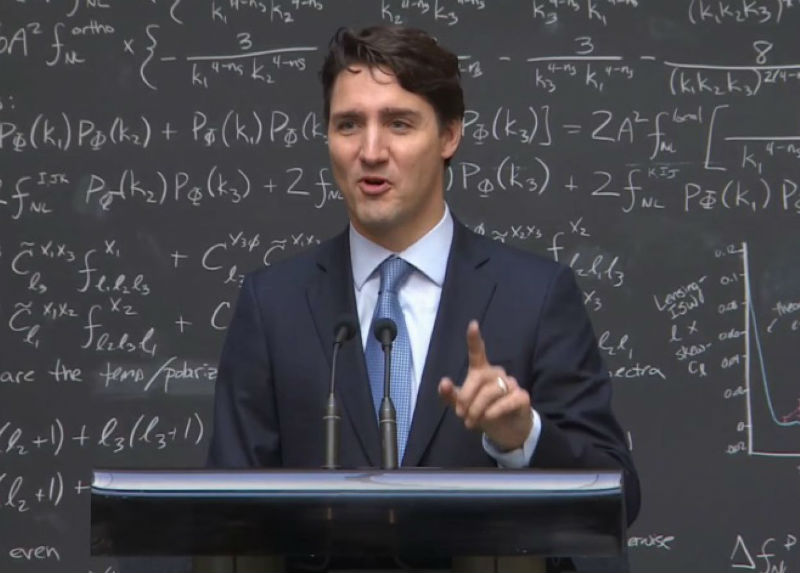

En 2016 la computación cuántica dio el salto a primera línea de la actualidad, gracias al discurso improvisado por el Primer Ministro de Canadá al ser preguntado por el tema por un periodista en una rueda de prensa.

En España contamos con uno de los mayores expertos del mundo en computación cuántica, se trata del físico Juan Ignacio Cirac quien trabaja como director de la División Teórica del Instituto Max-Planck de Óptica Cuántica.

En España contamos con uno de los mayores expertos del mundo en computación cuántica, se trata del físico Juan Ignacio Cirac quien trabaja como director de la División Teórica del Instituto Max-Planck de Óptica Cuántica.

El ordenador cuántico no lo vamos a utilizar para leer el correo electrónico o para hacer una compra por Internet, para eso ya tenemos nuestros ordenadores y además funcionan muy bien. El ordenador cuántico serviría para hacer cálculos potentes, cálculos que normalmente la gente no tiene por qué hacer, pero sí los que hacen diseño de materiales o desarrollo de fármacos. Juan Ignacio Cirac

Juan Ignacio Cirac expone claramente la problemática a la que se enfrenta actualmente el desarrollo de los ordenadores cuánticos: en los ordenadores clásicos, si almacenamos un bit de información al cabo de un tiempo todavía está allí. No pasa de cero a uno, simplemente se queda. Sin embargo en los ordenadores cuánticos, el bit cuántico, el equivalente al bit, es muy sensible y cualquier interacción que tenga con el entorno puede modificar completamente el cálculo. Por tanto hay que aislarlos bien, ese es el problema fundamental: cómo aislarlos bien. Si no están perfectamente aislados o se produce algún error, debemos pensar cómo corregirlo o cómo hacer para corregirlo. Esa es la parte fundamental de las investigaciones que se están produciendo actualmente al respecto.

Empresas que trabajan actualmente en el desarrollo de la Computación Cuántica

A este gran reto es al que se enfrenta la empresa canadiense D-Wave que en 2007 fue la primera en asegurar que había construido un ordenador cuántico. Tras el escepticismo inicial con el que fue acogida la noticia, se ha producido un interés creciente por parte de empresas e instituciones por acceder a su tecnología y adentrarse en el mundo de la computación cuántica. De esta forma empresas como Lockheed Martin y Google, instituciones como el Pentágono y la Nasa, incluso universidades, han comprado ya las dos versiones del computador cuántico que la empresa ha desarrollado hasta el momento. La computadora desarrollada por D-Wave está basada en una técnica conocida como computación cuántica adiabática, que implica el uso de circuitos de metales superconductores para enfriar el sistema. Si esto se realiza de forma precisa, los qubits de las máquinas buscan un estado de baja energía que representa la respuesta a un problema determinado. Por lo tanto la máquina es ideal para resolver los llamados «problemas de optimización», en los que hay una serie de criterios que deben cumplirse simultáneamente, y en los que hay una solución inmejorable que cumple con la mayoría de ellos, por ejemplo, la ruta óptima para que un camión de reparto minimice el tiempo y la distancia recorrida. Igualmente puede resultar de gran utilidad para encontrar la esencia de complejas estructuras de datos, algo que puede servir por ejemplo para la búsqueda y procesamiento de datos en redes sociales o en el reconocimiento de patrones en imágenes. La computadora cuántica será capaz de aprender las características clave de una forma particular, como la de un coche, al mostrarle muchas imágenes de coches. Una vez que las aprende, debería poder reconocerlas más fácilmente que los sistemas convencionales. Además, una vez que determine las características de lo que hace reconocible a un coche, puede usarlo para «entrenar» computadoras tradicionales, a reconocer de forma más simple a un coche. Esta es la razón por la que en 2013 Google compró a la empresa D-Wave un ordenador cuántico y tras instalarlo en el Centro de Investigación Ames de la NASA, lo han puesto a trabajar en su laboratorio cuántico de inteligencia artificial donde ha logrado hacerlo funcionar con una capacidad de cálculo 3.600 veces más rápida que un superordenador y 100 millones de veces más rápido que un ordenador normal. El último modelo de ordenador cuántico desarrollado por la empresa ha sido presentado a comienzos de 2017 y cuenta con una capacidad de 2.000 qubits.

Microsoft es otro de los gigantes tecnológicos que considera los ordenadores cuánticos como parte de su estrategia de futuro, en concreto con el desarrollo de la computación cuántica topológica, que consiste en controlar con precisión los movimientos de pares de partículas subatómicas al girar unas respecto a otras y permite manipular bits cuánticos enredados. Al entretejer las partículas, las computadoras cuánticas topológicas generarían hilos imaginarios cuyos nudos y giros crearían un sistema computacional poderoso. Lo que es más importante, la matemática de sus movimientos corregiría errores que hasta ahora han constituido el desafío más importante al que se enfrentan los diseñadores de computadoras cuánticas. Una de las iniciativas más recientes de la empresa, en lo que a computación cuántica se refiere, es la creación en 2014 del grupo Station Q, dirigido por el matemático Michael Freedman, que se encuentra en la Universidad de California, Santa Bárbara, un campus que se ha especializado en computación cuántica. En el tiempo que llevan trabajando en este campo la empresa asegura que han logrado enormes avances en la interfaz de semiconductores, lo cual permite que los materiales conductores se comporten como si fueran superconductores. Gracias a esto, los semiconductores pueden operar a velocidades de reloj extremadamente altas, con muy poco o nada de disipación de calor.

En este momento la computación cuántica es el área de inversión más grande de Microsoft Research, y tenemos la sensación de estar al borde de grandes logros científicos. Tenemos esperanza y optimismo en que estos avances conducirán a resultados prácticos, pero es difícil saber cuándo y dónde. Peter Lee, vicepresidente corporativo de Microsoft Research

En la conferencia SuperComputing 2015 en Austin, Texas, Dave Wecker, arquitecto líder del Grupo de Arquitecturas y Computación Cuántica en Microsoft Research QuArC, presentó una serie de herramientas publicadas en GitHub con el objetivo de que los científicos computacionales puedan simular las capacidades de una computadora cuántica. Esto resulta un paso crucial para fomentar la construcción de las herramientas informáticas necesarias que funcionarán en las computadoras cuánticas actuales. El software utilizado actualmente por Microsoft se llama Language-Integrated Quantum Operations o LIQUi|> y tiene como objetivo que los científicos computacionales, otros académicos e instituciones de investigación pueden perfeccionar los algoritmos que necesitan para utilizar de manera eficiente una computadora cuántica incluso aunque las computadoras estén en desarrollo de manera simultánea.

IBM tampoco podía quedarse fuera del gran desafío que supone la computación cuántica y para ocupar un espacio relevante, como el que está logrando en el mundo de la Inteligencia Artificial con Watson, la empresa puso en marcha en 2016 su iniciativa The IBM Quantum Experience que consiste en un servicio de computación cuántica en la nube. El objetivo es facilitar a los estudiantes, investigadores y entusiastas de la ciencia el acceso a la plataforma de computación cuántica experimental de IBM y permitir a los usuarios ejecutar los algoritmos y los experimentos en el trabajo de la empresa con con los bits cuánticos, además de poder explorar tutoriales y simulaciones de todo lo que podría ser posible gracias la computación cuántica. Gracias a esta iniciativa IBM ofrece sus resultados de más de 35 años de investigación en computación cuántica. Posteriormente en 2017 la empresa ha puesto en marcha el proyecto IBM Q que consiste en la línea comercial de ordenadores cuánticos pensados para empresas y laboratorios. A través de esta iniciativa se proporcionarán sistemas y servicios cuánticos a través de la plataforma IBM Cloud. Con ellos se podrán abordar problemas que actualmente son demasiado complejos para los sistemas informáticos clásicos como Watson y está previsto que una de sus principales aplicaciones será en el área de la química, para lo cual se han desarrollado técnicas que simulan problemas químicos en procesadores cuánticos, con la vista puesta en un futuro en el que se pueda trabajar con moléculas muy complejas y así poder predecir las propiedades químicas con mayor precisión. Además se ofrece una API de IBM Quantum Experience, con la que los desarrolladores podrán construir interfaces entre los nuevos ordenadores cuánticos y los clásicos, sin necesidad de tener conocimientos de computación cuántica. Esto forma parte de un SDK (Kit de desarrollo de software) que que la empresa ha preparado para que los usuarios construyan aplicaciones cuánticas sencillas y puedan experimentar con ellas en el simulador de IBM Quantum Experience.

Google también se muestra muy interesada en la computación cuántica. Más allá de lo que hemos visto en relación con cómo trabaja con los ordenadores cuánticos de la empresa D-Wave, también vale la pena conocer otros proyectos en los que participa como el que desarrolla junto con un equipo internacional de científicos de la Universidad de Sussex en Reino Unido, la Universidad de Aarhus en Dinamarca, la Universidad Siegen en Alemania y el laboratorio RIKEN en Japón. Para ello se ha presentado un estudio con una nueva invención en la que los bits cuánticos reales pueden transmitirse entre módulos de computación cuánticos individuales, con el fin de poder crear una máquina a gran escala totalmente modular. Hasta el momento los científicos habían propuesto usar conexiones de fibra óptica para conectar los módulos de computación individuales, pero en este proyecto se apuesta por los campos eléctricos que permite que los átomos cargados sean transportados de un módulo a otro. Gracias a este nuevo enfoque de diseño se pueden lograr velocidades de conexión 100.000 veces más rápidas entre los diferentes módulos de computación cuántica que componen la máquina.

Durante muchos años, la gente dijo que era completamente imposible construir ordenador cuántico real. Con nuestro trabajo no solo hemos demostrado que puede hacerse, sino que ahora presentamos un plan de construcción concreto. Winfried Hensinger, científico de la Universidad de Sussex

Los ordenadores biológicos como una nueva forma de entender la informática

La computación biológica consiste en el uso de organismos vivos, o sus componentes, para realizar cálculos computacionales u otro tipo de operaciones asociadas con la computación. El objetivo de esta nueva línea de actividad dentro del mundo de la informática es llegar a desarrollar un futuro ordenador basado en ADN, o la utilización de células vivas para la realización de cálculos computacionales. El principal promotor de esta disciplina es Leonard Adleman, profesor en ciencias de la computación y biología molecular de la Universidad del Sur de California, inventor de la criptografía RSA (Rivest-Shamir-Adleman) y de la computación por ADN. En 1994, publicó un artículo describiendo un experimento que utilizaba el ADN como un sistema computacional. En él resolvía la instancia con siete nodos del problema del camino hamiltoniano. Dicho problema es NP-completo. Aunque su solución era trivial, este experimento fue la primera ocasión en la que se utilizó satisfactoriamente el ADN en una computación de un algoritmo. Actualmente la computación biológica discurre por varias vías diferenciadas, entre las que podemos encontrar los trabajos en los que se asocian los organismos vivos con sistemas de computación convencionales, los ordenadores basados en la estructura del ADN y el desarrollo de células vivas con capacidades computacionales

Las investigaciones que se realizan para el desarrollo de computadoras basadas en ADN buscan aprovechar al máximo la capacidad de esta molécula para la realización de cálculos y el almacenamiento de información, al igual que ha sido capaz de hacerlo para codificar la estructura de los organismos vivos, podría hacerlo también para otras utilidades buscadas por el hombre. En concreto en cuanto a su capacidad para almacenar información podemos fijarnos en los siguientes datos: un tubo de ensayo puede contener 1.018 moléculas de ADN, una simple operación sobre el tubo de ensayo supone del orden de 1.018 operaciones simultáneas, lo que equivale a más de 10 trillones de moléculas de ADN podrían ocupar no más de 1 centímetro cúbico. Gracias a esto una computadora de ADN podría contener 10 TB de datos y una capacidad de 10 trillones de procesos de cálculo al mismo tiempo.

Entre los distintos avances que se están produciendo en el ámbito de la computación biológica podemos mencionar el trabajo que realizan los científicos del Instituto Technion-Israel de Tecnología que han desarrollado y construido un transductor biológico avanzado, que funciona como una máquina de cálculo capaz de manipular códigos genéticos, y de usar los resultados para poder realizar cálculos posteriores. El avance podría dar lugar a nuevas posibilidades en biotecnología, como por ejemplo la terapia genética individualizada. Los resultados de esta investigación muestran una nueva máquina sintética de computación, que calcula iterativamente y produce resultados biológicamente relevantes, además de mejorar la potencia de cálculo de los ordenadores convencional, este transductor basado en ADN ofrece múltiples beneficios, incluyendo la capacidad de leer y transformar la información genética, miniaturización a escala molecular y la capacidad de producir resultados computacionales que interactúan directamente con los organismos vivos.

También investigadores de la Universidad McGill de Canadá, junto con científicos de Alemania, Suecia y Países Bajos, trabajan en el desarrollado de la computación biológica desde un nuevo enfoque, que puede resolver los problemas actuales de la utilización de estas tecnologías. Su trabajo consiste en crear un modelo de computación biológica en el que, en lugar de electrones, se emplean filamentos de proteínas para transmitir la información. Se trata de un microchip de un tamaño reducido, de 1,5 cm2 aproximadamente, con una estructura de cuadrícula de canales por los que circulan las cadenas de proteínas. Una de las ventajas de este prototipo en comparación con los superordenadores electrónicos es que apenas se calienta y necesita mucha menos energía para funcionar, de manera que este modelo es mucho más sostenible. En las pruebas de concepto que se han realizado hasta el momento, el microchip biológico ha demostrado que tiene la capacidad de resolver un problema matemático complejo de una manera eficiente, pero todavía no es comparable a la eficacia de los chips electrónicos, por lo que los investigadores aun tienen mucho trabajo por delante para conseguir un equipo completamente funcional.

Al igual que hemos visto en el caso de la Computación Cuántica, en lo que a Computación Biológica se refiere, también nos encontramos con que las grandes empresas tecnológicas han decidido no quedarse fuera de las mejoras que este tipo de tecnologías pueden llegar a ofrecer respecto de la computación convencional. Es el caso de Microsoft, que colabora con la startup Twist Bioscience, con el objetivo de utilizar el ADN como banco para almacenar grandes cantidades de información. Twist Bioscience fue fundada en 2013 en San Francisco y desde entonces ha realizado cuatro rondas de inversión por valor de 113 millones de dólares. La empresa ha proporcionado a Microsoft 10 millones de moléculas de ADN con los que trabajará en el objetivo de usar el ADN para almacenar información. Las estimaciones ofrecidas por la empresa indican que se podrían almacenar mil millones de terabytes en un gramo de ADN, durante miles de años. La gran dificultad actual para el uso del ADN como un medio de almacenamiento masivo de datos se encuentra en leer y escribir la información que se quiere almacenar. En la parte de la escritura es donde Twist Bioscience trabaja produciendo strings de material genético creados especialmente para la ocasión y que se generan a través de su propia tecnología. Para utilizar el ADN en el almacenamiento de información, se utiliza el material biológico como si fuese cualquier otro medio digital. Las hebras de código genético se codifican, y se asigna a cada una de sus bases un valor binario. En lugar de datos binarios que se codifican como regiones magnéticas en una unidad de disco duro, se sintetizan hebras de ADN que almacenan 96 bits donde cada una de las bases (TGAC) representan un valor binario (T y G = 1, A y C = 0). Además de la gran capacidad que ofrece el ADN para almacenar información es importante destacar también que no requiere ningún tipo de consumo energético, por lo que puede almacenar información durante miles de años sin ningún coste.

Y para terminar veamos un ejemplo de que en el mundo de la computación aún hay muchísimo por hacer y también de cómo a veces una casualidad puede abrir un nuevo mundo de opciones a la hora de mejorar cómo trabajan las computadoras en estos momentos. Hablamos del chip S1, desarrollado por la empresa Singular Computing, que ha sido programado para errar en sus cálculos. Su creador Joseph Bates indica que estos chips informáticos están programados para ser incapaces de realizar correctamente los cálculos matemáticos, por ejemplo cuando tiene que realizar el cálculo 1 + 1 ofrece respuestas como 2,01 o 1,98. Lo que a primera vista puede parecer un despropósito, sin embargo representa una ventaja a la hora de resolver algunos de los problemas más difíciles para los ordenadores, como entender un vídeo u otros datos engorrosos del mundo real, ya que un chip que garantiza cálculos imprecisos puede conseguir buenos resultados en muchos problemas, necesitando menos circuitos y consumiendo menos energía. De esta forma la empresa trabaja con el Laboratorio Nacional Sandía, la Universidad de Carnegie Mellon, la Oficina de Investigación Naval y el Instituto Tecnológico de Massachusetts, en investigaciones que tienen el objetivo de demostrar que las operaciones inexactas del chip S1 pueden aumentar la eficiencia de determinadas tareas de computación complejas. Los problemas con datos que aportan el ruido del mundo real, o donde se necesite alguna aproximación son los usos más adecuados para este chip, que ofrece resultados prometedores para aplicaciones como la imágenes de radar de alta resolución, extraer información en 3D de las imágenes estereoscópicas y el aprendizaje profundo que se utiliza para el desarrollo de la Inteligencia Artificial. Para demostrar la utilidad de S1 se ha realizado una prueba con un software que rastrea los objetos dentro de un vídeo, siendo capaz de procesar fotogramas casi 100 veces más rápido que un procesador convencional diseñado para ejecutar correctamente los cálculos. Además, su consumo energético fue inferior al 2% que el de sus homólogos precisos. El proyecto está siendo financiado por la agencia militar DARPA como parte de un programa llamado Upside dirigido a inventar formas más eficientes de procesar las imágenes de vídeo, que por ejemplo son captadas por los drones militares que pueden recopilar vastas cantidades de vídeo, pero no siempre pueden ser descargadas durante el vuelo.

Hasta aquí hemos llegado con un repaso a las principales iniciativas a nivel mundial para encontrar alternativas a las limitaciones actuales a las que se enfrenta el mundo de la computación, desde la utilización de materiales alternativos al silicio hasta la invención de nuevas formas de computación, como la computación cuántica y la computación biológica, que permitan afrontar la gran demanda que se va a producir en los próximos años por parte de las personas y las empresas en la utilización de tecnologías que empiezan a coger fuerza como es la Realidad Virtual, la Inteligencia Artificial y el Vehículo Autónomo.

Etiquetas: Intel, materiales, Silicio

3 Comentarios

Rafa

AMD no le ha ganado la batalla a Intel, en todo caso será Qualcomm.