Pausar los grandes experimentos de Inteligencia Artificial

Publicado el 03 abril, 2023

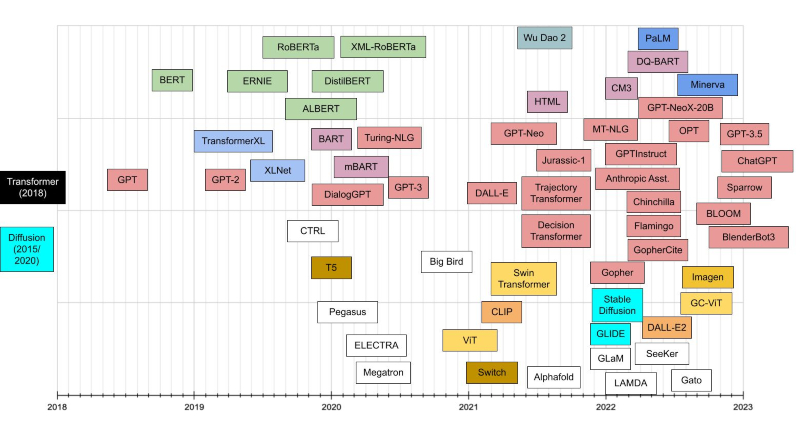

Qué momento tan apasionante para dedicarse a la tecnología, donde cada día queda más claro que con las innovaciones en Inteligencia Artificial se están repitiendo los momentos equivalentes a la década de los 80 cuando se popularizó la informática y de los 90 cuando ocurrió lo propio con Internet.

Aunque estos momentos tan estimulantes no están libres de polémica, como la que ha surgido esta semana con la publicación de la carta abierta Pause Giant AI Experiments, firmada entre otros por grandes figuras tecnológicas como Elon Musk y Steve Wozniak, en la que se pretende que se realice una pausa para reflexionar al respecto de los peligros que conlleva la Inteligencia Artificial y si insta a los Estados a regular esta tecnología.

Lo que acabará ocurriendo te lo puedes imaginar, se harán leyes, muchas de ellas lo único que lograrán es perjudicar a los usuarios, como ha ocurrido por ejemplo con la ley de cookies, pero lo que realmente pide la gente no se logrará y solo se habrá perdido mucho tiempo y dinero público en el proceso.

¿Qué vamos a hacer el nuevo ruido informativo que se va a generar con la Inteligencia Artificial?

Partiendo de la base de que ruido informativo y desinformación ha existido siempre, solo hay que remontarse a la historia de Pedro y el lobo, lo que parece claro es que ahora esto se va a intensificar, al menos al ritmo de lo que ya lo venía haciendo desde la llegada de los medios de comunicación masiva. Lo que puede ocurrir ahora es que la bola puede hacerse mucho más grande cuando la Inteligencia Artificial se alimente de basura informativa para generar aún más basura informativa. Lo que ha ocurrido con el SEO y el clickbait es buena prueba de ello. Además también parece claro que en este caso el fuego no puede apagarse con más fuego y por mucho que nos empeñemos, cada vez que se desarrolle una IA capaz de detectar el contenido creado por IA alguien inventará otra IA capaz de engañar a la otra IA.

Así que me temo que no queda otro remedio que aceptar que no podremos dar como cierto o seguro nada de lo que nos encontremos en Internet y parte de nuestro trabajo será aprender a tomar decisiones en esa situación de incertidumbre, lo cual para algunos puede sonar terrible pero para los que tengan el sentido crítico bien desarrollado esto no supondrá un problema. Si partimos de la base de que la realidad no existe, ¿por qué tenemos que empeñarnos en tener certeza absoluta de si un contenido ha sido realizado realmente por una persona o si una noticia es realmente cierta?. Aprender a tomar decisiones en una situación de alta incertidumbre resultará de gran valor en el futuro, pero esto no es nada nuevo, en la prehistoria cuando sabíamos muy poco de todo lo que nos rodeaba nuestra especie también fue capaz de adaptarse y sobrevivir.

¿Qué va a ocurrir con la gente que no quiera o no pueda sumarse a la revolución de la Inteligencia Artificial?

Cada vez que surge una nueva tecnología que puede cambiarlo todo aparece gente que intenta oponerse a ese progreso y curiosamente esa gente suele lograr bastante protagonismo en los medios de comunicación, que muchas veces también parecen oponerse a esas tecnologías, porque suponen el enésimo ataque a la línea de flotación de su modelo de negocio tradicional.

Pero más allá de la gente que se oponga ideológicamente al desarrollo de estas tecnologías, también nos vamos a encontrar con muchas personas que no tienen capacidad para adaptarse a ellas, no disponen de los recursos necesarios o simplemente se sienten desbordados ante tanto avance y no quieren hacer otro cambio más en sus vidas para adaptarse al ritmo que les impone la sociedad.

La buena noticia aquí es que muchos de los avances que se produzcan gracias a la Inteligencia Artificial también beneficiarán a aquellos que se opongan a su desarrollo, porque como estamos viendo, aunque el protagonismo en estos momentos lo tenga las aplicaciones dirigidas al uso por parte de particulares, también se sigue avanzando muchísimo en el desarrollo de aplicaciones enfocadas a ámbitos como la salud, el transporte, la sostenibilidad, …

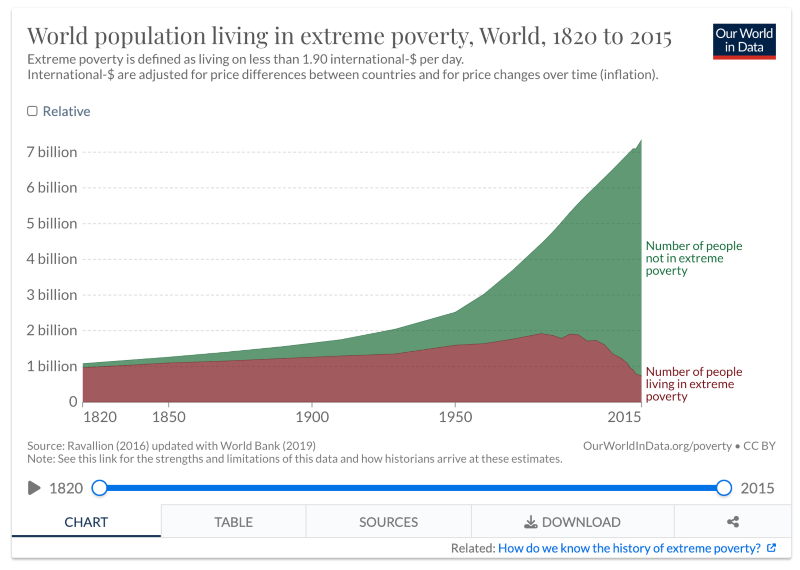

Y sobre todo, donde la sociedad en su conjunto puede salir beneficiada, es si realmente esta tecnología logra incrementar la productividad a nivel mundial, un tema que a nivel económico resulta cada vez más preocupante sobre todo en occidente, donde la productividad se ha reducido mucho en las últimas décadas. Lo que ocurre es que aquí no queda otro remedio que hablar de renta básica universal, algo con lo que de hecho son partidarios en OpenAI.

El problema de la renta básica universal es que no soluciona precisamente los problemas que vivimos en occidente, especialmente los relacionados con la convivencia y el bienestar psicológico. Porque no cabe duda de que poder ofrecer esa renta a las personas que se encuentran en situación de pobreza podría resultarles muy beneficioso, pero a otros muchos que ya disponen de los recursos básicos para sobrevivir, pero aún así no son felices, tampoco les va a cambiar la vida.

Por lo tanto mi opinión es que los avances a nivel tecnológico deberían ayudarnos a avanzar también como sociedad, especialmente en lo que a valores y cultura se refiere, aprovechando para recuperar muchas de las actividades que hemos dejado de hacer por falta de tiempo, al tener que dedicar todo el día a trabajar y que son las cosas que precisamente muchas veces comienzan a hacer los jubilados: aprender, cocinar, pasear, cultivar, leer, dormir, pintar, meditar, … y sobre todo socializar.

¿Cómo vamos a protegernos de los malos usos que se puedan hacer de la Inteligencia Artificial?

La historia nos enseña que cualquier tecnología puede ser utilizada para hacer el mal y que en algún momento algún descerebrado hará alguna barbaridad que perjudicará a muchísimas personas. La duda aquí es si el resultado final será a favor de la humanidad o por el contrario, como algunos vaticinan, la Inteligencia Artificial llegará a tal grado de desarrollo que nos acabará dominando y haciendo con nosotros lo que le plazca.

Pero hasta que ese momento llegue deberíamos concienciarnos de la posibilidad de unos usos más «humanos» de esta tecnología para hacer el mal, por ejemplo saber en que ahora además de armas en manos de desalmados, también habrá armas programadas por desalmados.

Lo que ocurre es que si queremos que esta tecnología nos ayude realmente a resolver los retos que enfrenta la humanidad, por ejemplo a nivel de salud y sostenibilidad, necesitamos que sea lo más libre y accesible posible, por lo cual todo lo que suponga prohibiciones y restricciones jugará en nuestra contra en general impidiendo que no solo se pueda usar para hacer el mal, sino sobre todo para hacer el bien.

¿Qué vamos a hacer con todo el nuevo tiempo disponible que nos regale la Inteligencia Artificial?

Recientemente Ángel Alba, Fundador y CEO Innolandia.es, ha escrito un artículo muy interesante sobre 5 procesos de innovación donde aplicar ChatGPT en el que explica que actualmente vivimos en un hype de herramientas de Inteligencia Artificial Generativa, sin embargo, donde más podemos sacarle partido es explorando y sistematizando casos de uso específicos. No se trata tanto la herramienta sino la utilidad de la misma.

En el caso de la innovación, esta tecnología no va a sustituir a los profesionales de la innovación, sino que los “va a aumentar”. Va a permitirnos acelerar procesos de innovación, analizando grandes cantidades de insights, adoptar otros puntos de vista que no pensábamos o explorar nuevas oportunidades.

Es lo que en Innolandia llaman “Innovación Aumentada”: la capacidad de colaborar entre personas e inteligencia artificial para la generación, desarrollo y puesta en marcha de nuevos productos, servicios o procesos de negocio.

Más allá de la generación de ideas, podemos utilizar la GenAI en 5 procesos clave de innovación:

- Para planificar la innovación, definiendo objetivos, tesis y oportunidades.

- Para todo el proceso de ideación, por ejemplo aplicándolo en todas las fases de design thinking, desde explorar problemas, generar ideas, evaluarlas o incluso prototipar.

- Para gestionar proyectos, aplicando Lean start-up (experimentos de validación), desarrollo tecnológico o incluso hacer seguimiento.

- Para diseñar y gestionar el sistema de innovación, proponiendo criterios de embudos, KPIs o analizando informes de vigilancia tecnológica.

- Para construir cultura innovadora, creando contenidos o formaciones.

Frente a la avalancha de nuevas herramientas que salen cada día, creo que es mucho más efectivo especializarse en aplicaciones generalistas y adaptarlas a las necesidades de cada caso, siempre aplicando el pensamiento crítico. Reducimos la curva de aprendizaje y obtendremos resultados antes.

Esto es lo que ayudamos a hacer a nuestros clientes y enseñamos en nuestro curso de Innovación Aumentada: Inteligencia Artificial para gestores de la innovación. Un curso vertical enfocado a casos de uso específicos de nuestra área.

¿Cómo estás usando actualmente ChatGPT en tu trabajo de consultoría de innovación?

La verdad es que la idea de aplicar la IA en nuestros proyectos viene de hace tiempo. Lo veía como un consultor virtual que eliminara nuestra dependencia de las horas. Creo que fue en 2019 cuando hicimos un primer piloto de un chatbot para gestores de innovación, con contenido específico, junto a la start-up Zappiens, pero los clientes no lo usaban.

Así que cuando mi amiga Ana Poveda me habló de una herramienta para escribir posts y newsletters en lenguaje natural en primavera de 2022, empecé a cacharrear. Escribí mi primer post con GPT3 en julio de 2022 y a comentar con otros colegas, como Néstor Guerra, la potencia que tenía esto. A partir de ahí nos planteamos ¿cómo podemos aplicar esta técnica en los proyectos?

Así que como siempre hacemos con cualquier herramienta, primero empezamos en nuestra propia empresa y nos aplicamos nuestra propia medicina. Una vez que aprendimos nosotros, lo llevamos a nuestros clientes. La primera aplicación que hicimos fue para priorizar una serie de iniciativas de innovación en un cliente, en diciembre 2022.

Recuerdo que en el proceso de aprendizaje autodidacta había diseñado un prompt en el playground de GPT3 sobre una matriz impacto – esfuerzo, con 4 cuadrantes, a base de tutoriales y prueba-error. Lo tenía de back-up en la sesión con el cliente.

En el taller con el cliente, empezamos a debatir la primera iniciativa, tardamos 10 minutos en clasificarla, teníamos 35 y yo un AVE de vuelta a Alicante. Así que proyecté el prompt en la pantalla, metimos las iniciativas y en 10 segundos estaban clasificadas. Las revisamos una a una y en el 90% de las clasificaciones el equipo esta a de acuerdo. En 2 horas hicimos el trabajo que podía haber tardado 6 horas.

A partir de aquí, hemos ido troceando las actividades de innovación para construir casos de uso específicos: mapas de empatía, business model canvas, planes de proyectos, diseño de KPIs, propuestas de comités de innovación, etc…

¿Puedes contarnos algún ejemplo de algún proyecto concreto en el que lo estés usando?

Desde diciembre aplicamos la GenAI en todos los proyectos que hacemos con clientes. Cada día descubrimos un caso de uso nuevo, en función del viaje por el que pasa cada equipo del cliente.

Un caso que me gustó mucho fue diseñar un programa de intraemprendimiento para una gran empresa agroquímica, con la ayuda de ChatGPT. Lo que hicimos fue dividir el proceso de diseño en pequeñas actividades: priorizar los vectores de innovación, generar retos, crear los criterios de selección de ideas, diseñar el formulario de registro, definir el plan de comunicación y redactar los copys de los mensajes. Todo esto en un día completo con un equipo de 3 personas y 1 de Innolandia.

Otro caso donde le veo también mucha potencia es en resumir información. Aunque ChatGPT aún no es capaz de leer links, le hemos copiado el texto de informes de vigilancia tecnológica para resumirlos en incluso locutarlos (con otra aplicación) para facilitar el consumo y la toma de decisiones.

Finalmente otro ejemplo que estamos afinando es utilizar DALL·E para una primera versión de los prototipos de producto o servicio. Antes pedíamos a los equipos que hicieran un dibujo en una servilleta, para pasar la idea del post-it al mundo físico. Ahora podemos empezar a trabajar con DALL·E. Todavía no lo hacemos con MidJourney, porque a estos niveles quizás es poco “user-friendly”.

Mi aprendizaje durante estos meses es que debemos trocear las actividades de innovación para crear casos de uso específicos, más que ir a hacer preguntas más genéricas del tipo “dame ideas sobre tal cosa”.

¿Qué problemas observas actualmente en esta tecnología en relación con su uso a nivel de innovación?

Yo creo que muchas personas están todavía deslumbradas por el resultado pero sin acabar de ver la utilidad, porque no saben cómo hacerlo. Cuando preguntamos a nuestros clientes, que suelen ser gestores o directivos de innovación, quién tiene experiencia utilizando estas herramientas, aproximadamente el 50% nos dice que las ha probado. Y de ese 50%, el 90% sólo ha probado ChatGPT y para jugar un rato.

Para entender la utilidad real y sacarle el máximo provecho, creo que hacen falta tres cosas:

- Primero entender muy bien el proceso de innovación y dividirlo en pequeños pasos. Porque ahí es donde la GenAI te podrá ayudar. No en grandes procesos o preguntas generalistas, sino en pequeños pasos. Dividir un proceso de design thinking en crear el reto, generar arquetipo, diseñar una entrevista de problema, analizar los insights, etc, etc… Si no conoces bien tu proceso, será complicado que construyas casos de uso potentes.

- Segundo, aprender a preguntar. En el equipo de Innolandia no somos informáticos, no sabemos programar. Pero estamos aprendiendo a desarrollar prompts en lenguaje natural muy estructurados, porque la diferencia entre darle una instrucción simple (un zero prompt) a un prompt con contexto y ejemplos es abismal. Por ejemplo, tenemos una plantilla de prompt para evaluar ideas en GPT3 que incluye los criterios de encaje estratégico, deseabilidad, factibilidad y viabilidad y donde cada criterio puede tomar 3 valores. Lo que hemos hecho ha sido pasar nuestro Excel de evaluación de ideas a GPT3 para que nos ayude. Y eso es mucho más que pedirle a ChatGPT que nos evalúe las ideas sin más.

- Y tercero, aplicar el pensamiento crítico. Como decía Enrique Dans, el trabajo de los profesionales del conocimiento (y los gestores de la innovación lo somos) no es realizar tareas repetitivas sino aplicar el pensamiento crítico. Puedes pedirle a ChatGPT que te analice 20 test de producto y obtener patrones, pero ¿tienen sentido? ¿están sesgados? Eso es trabajo humano.

¿Cómo piensas que puede evolucionar esta tecnología y cómo crees que puede ser el impacto futuro en tu actividad?

Te reconozco que estoy desbordado por todas las noticias nuevas que salen cada día y soy incapaz de seguir el ritmo de locura. Pero lo que tengo claro es que, como cualquier tecnología, la GenAI sólo tendrá éxito si soluciona un problema real de las personas, se construyen casos de uso y modelos de negocio que permitan explotarlo. Ejemplos de tecnologías con hype muy alto y que luego no han llegado a nada hay infinitas.

A nivel de mi actividad de consultoría de innovación o el trabajo de los propios equipos de innovación creo que tiene muchísimo potencial. El problema que resuelve está claro: ayudarnos a innovar más rápido, con la gestión de volúmenes importantes de datos o tareas que suponen gran cantidad de trabajo. Un caso que nos ha pasado recientemente es que ayudamos a un cliente de alimentación a hacer un test de 9 productos, con 18 betatesters cada uno. Total 162 mini test. Imagina al menos 4 insights por test, nos vamos a más de 500 insights.

Antes de GPT, nos teníamos que encerrar con un Excel o pasar a mano las notas a 500 post-its, pegarlos en la pared y hacer el ejercicio de mural del cliente, para encontrar patrones. En este caso, utilizamos Super.ai, para pasar el texto manuscrito a digital y ChatGPT para identificar patrones. Luego los revisamos, pero hicimos en 1 mañana el trabajo que antes tardábamos 2 días con varias personas.

Otra opción con un cliente fue aplicando la estrategia del océano azul. Mientras que un equipo de 5 personas generaba una caso, con ChatGPT creamos 10. El doble, en el mismo tiempo. Y con algunas opciones muy interesantes, que no se le había ocurrido a nadie del equipo.

Ahorraremos tiempo de tareas, que deberemos dedicarlo a pensar cómo hacer preguntas y a validar o modificar la información que obtengamos.

Etiquetas: ChatGPT, GenAI, innovación

Muy recomendable escuchar

Muy recomendable escuchar